tecnología

Aug 6, 2024

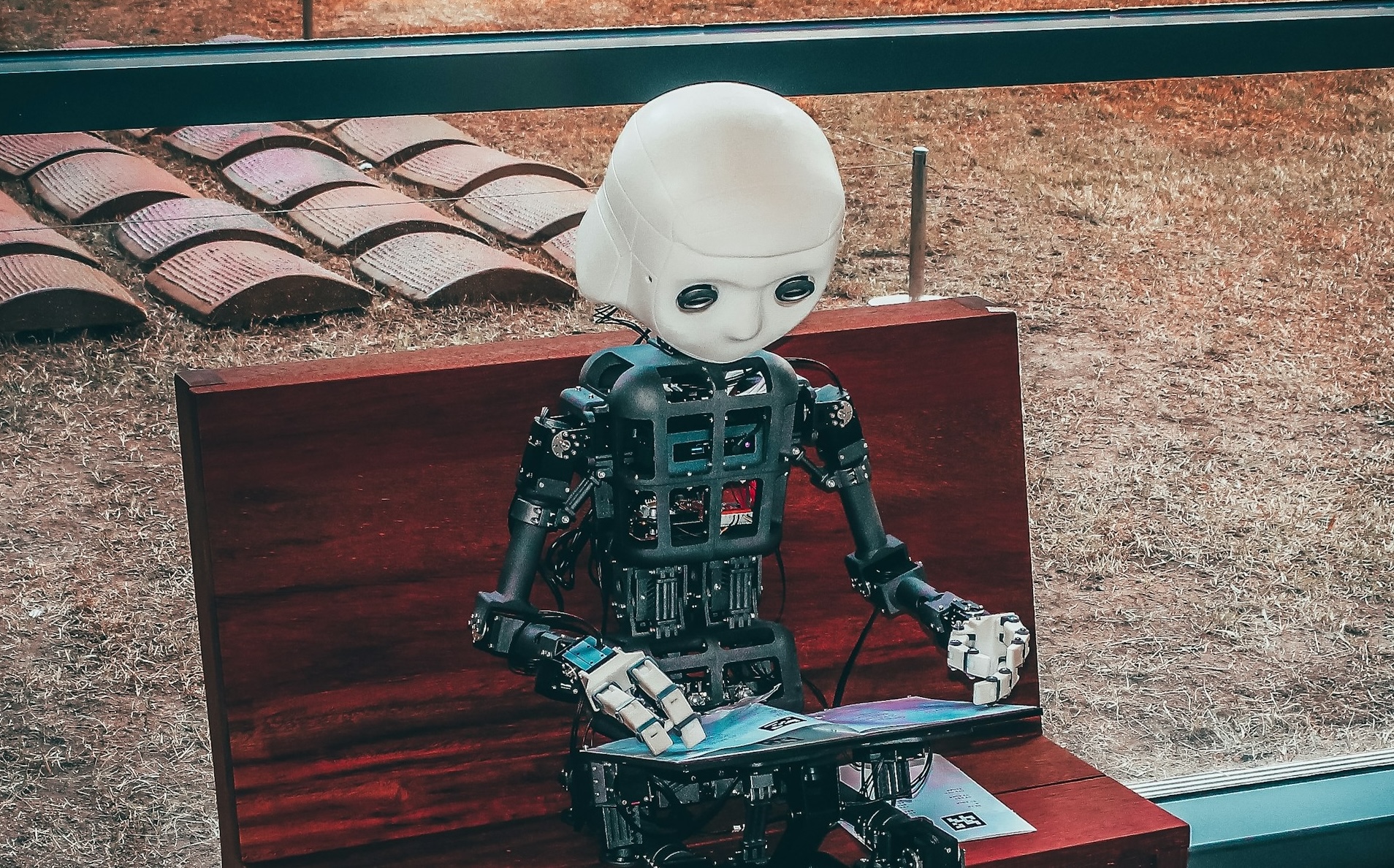

El Futuro de la IA y la Ética

Navegando los desafíos venideros

4 min read

La Inteligencia Artificial (IA) está transformando nuestro mundo a un ritmo sin precedentes, revolucionando industrias desde la salud hasta las finanzas y más allá. Aunque los beneficios potenciales de la IA son inmensos, también conllevan consideraciones éticas significativas que debemos abordar para asegurar un futuro justo. En este blog, exploraremos algunos de los desafíos éticos clave que plantea la IA y discutiremos cómo podemos navegarlos.

1. Sesgo e Imparcialidad

Los sistemas de IA aprenden de datos, y si esos datos contienen sesgos, la IA inevitablemente los reproducirá. Esto puede llevar a resultados discriminatorios en áreas críticas como la contratación, los préstamos y la aplicación de la ley. Por ejemplo, una IA utilizada en reclutamiento podría favorecer a candidatos masculinos si ha sido entrenada con datos históricos sesgados. En otro caso, un sistema de policía predictiva podría apuntar desproporcionadamente a ciertas comunidades minoritarias si los datos de entrenamiento reflejan sesgos históricos en la policía.

2. Abordando el Sesgo:

- Conjuntos de Datos Diversos: Asegurar que los datos de entrenamiento sean representativos e inclusivos de todos los grupos demográficos es crucial. Esto implica recopilar datos de diversas fuentes y buscar activamente incluir a grupos sub-representados. Técnicas como el sobremuestreo de clases minoritarias pueden ayudar a equilibrar los conjuntos de datos.

- Auditorías de Sesgos: Auditar regularmente los sistemas de IA en busca de sesgos implica usar herramientas y marcos diseñados para detectar y medir sesgos en los resultados de la IA. Esto puede incluir medidas estadísticas, métricas de imparcialidad y evaluaciones de impacto en el mundo real.

- Transparencia: Hacer transparentes los procesos de toma de decisiones de la IA significa proporcionar información sobre cómo la IA llega a sus conclusiones. Esto puede lograrse mediante técnicas de interpretabilidad del modelo, que ayudan a explicar los factores que influyen en las decisiones de la IA. La transparencia construye confianza y permite a las partes interesadas analizar y desafiar resultados sesgados.

3. Preocupaciones sobre la Privacidad

Los sistemas de IA a menudo requieren vastas cantidades de datos personales para funcionar de manera efectiva. Esto plantea preocupaciones sobre la privacidad de los datos y el potencial de abuso. Por ejemplo, la tecnología de reconocimiento facial puede utilizarse para vigilancia, infringiendo los derechos de privacidad de las personas. Los datos de salud utilizados en la IA para diagnósticos médicos podrían exponerse si no se aseguran adecuadamente, comprometiendo información sensible.

Protegiendo la Privacidad:

- Anonimato de Datos: Implementar técnicas para anonimizar los datos personales implica eliminar o encriptar información de identificación personal (PII) para que las personas no puedan ser identificadas fácilmente. Técnicas como la privacidad diferencial añaden ruido a los datos para proteger las identidades individuales mientras permiten el análisis agregado.

- Controles de Acceso Estrictos: Limitar el acceso a datos sensibles asegura que solo el personal autorizado pueda ver o manipular los datos. Esto implica controles de acceso basados en roles, encriptación y mecanismos de autenticación seguros.

- Cumplimiento de Regulaciones: Adherirse a leyes de protección de datos como el Reglamento General de Protección de Datos (GDPR) y la Ley de Privacidad del Consumidor de California (CCPA) implica implementar medidas que aseguren los derechos de los sujetos de datos. Esto incluye dar a los usuarios control sobre sus datos, asegurar la portabilidad de datos y realizar evaluaciones de impacto de protección de datos.

4. Desplazamiento Laboral

A medida que la IA automatiza tareas rutinarias, crece la preocupación por el desplazamiento laboral. Aunque la IA tiene el potencial de crear nuevas categorías de empleo, la transición puede ser desafiante para los trabajadores en roles tradicionales. Por ejemplo, la automatización impulsada por IA en la manufactura puede llevar a la pérdida de empleos para los trabajadores de la línea de montaje, mientras que crea nuevas oportunidades en el mantenimiento y supervisión de IA.

Mitigando el Desplazamiento Laboral:

- Programas de Recapacitación: Invertir en programas de capacitación para ayudar a los trabajadores a adquirir nuevas habilidades relevantes para la economía impulsada por la IA es esencial. Gobiernos, instituciones educativas y empresas deben colaborar para ofrecer capacitación en áreas como la IA, la ciencia de datos y la manufactura avanzada.

- Aprendizaje Continuo: Fomentar una cultura de aprendizaje continuo y adaptación implica promover políticas que apoyen la educación continua y el desarrollo profesional. Cursos en línea, talleres y certificaciones pueden ayudar a los trabajadores a mantenerse al día con los avances tecnológicos.

- Sistemas de Apoyo: Implementar redes de seguridad social para apoyar a los trabajadores desplazados durante las transiciones incluye beneficios de desempleo, servicios de colocación laboral y asesoramiento profesional. Estas medidas ayudan a los trabajadores a navegar la transición hacia nuevas industrias y roles.

5. Desarrollo Ético de la IA

El desarrollo y despliegue de la IA debe guiarse por principios éticos para prevenir daños y asegurar que la tecnología beneficie a toda la sociedad. Esto implica tomar decisiones deliberadas sobre cómo se utiliza la IA y asegurar la rendición de cuentas. El desarrollo ético de la IA requiere un enfoque multidisciplinario, involucrando a éticos, sociólogos y tecnólogos.

Promoviendo una IA Ética:

-

Directrices Éticas: Desarrollar y adherirse a directrices éticas para el desarrollo de la IA implica crear marcos que delineen principios como imparcialidad, transparencia, responsabilidad y respeto por los derechos humanos. Estas directrices deben incorporarse en cada etapa del ciclo de vida de la IA.

-

Participación de las Partes Interesadas: Involucrar a diversas partes interesadas en el diseño e implementación de sistemas de IA asegura que se consideren múltiples perspectivas, especialmente las de comunidades marginadas y vulnerables. Esto puede lograrse mediante consultas públicas, talleres y métodos de diseño participativo.

-

Mecanismos de Responsabilidad: Establecer una clara responsabilidad por las decisiones y resultados de la IA implica crear mecanismos para monitorear y evaluar el impacto de los sistemas de IA. Esto incluye establecer organismos de supervisión independientes, implementar registros de auditoría y asegurar que haya vías para la reparación cuando los sistemas de IA causen daño.

6. Toma de Decisiones Autónoma

Los sistemas de IA, especialmente en áreas como vehículos autónomos y salud, toman decisiones críticas que pueden tener consecuencias de vida o muerte. Asegurar que estas decisiones se tomen de manera ética es primordial. Por ejemplo, un vehículo autónomo debe ser capaz de tomar decisiones en fracciones de segundo en situaciones de emergencia, mientras que un sistema de IA utilizado en diagnósticos médicos debe asegurar la seguridad y el bienestar del paciente.

El futuro de la IA tiene un gran potencial, pero para realizarlo plenamente es necesario abordar importantes desafíos éticos. Priorizando la imparcialidad, la privacidad y la responsabilidad, y apoyando a aquellos afectados por el cambio tecnológico, podemos aprovechar el poder de la IA de manera que beneficie a toda la sociedad. Como desarrolladores, legisladores y usuarios, es nuestra responsabilidad colectiva dar forma al futuro de la IA de manera ética e inclusiva.